Comparo o HTTP/3 Push e o Preload com base em valores reais medidos e explico qual tecnologia é a mais eficiente. Desempenho do http3 notavelmente para frente. Para isso, analiso as vantagens do QUIC, as prioridades de carregamento e os erros típicos de implementação que afetam o First Paint e o Renderizar freios.

Pontos centrais

Resumi os seguintes pontos-chave para que você possa escolher rapidamente entre pressão e pré-carga. categorizar pode.

- HTTP/3O QUIC elimina o bloqueio de cabeça de linha e mantém os fluxos funcionando sem problemas em caso de perdas.

- EmpurreA entrega proativa ajuda com ativos essenciais altamente prováveis, mas envolve despesas gerais.

- Pré-cargaDeclarativo, controlável, de baixo risco com priorização de recursos críticos.

- Valores medidosVantagens do HTTP/3: as vantagens do HTTP/3 são claramente evidentes com a perda de pacotes e muitos ativos.

- EstratégiaA combinação de pré-carregamento e HTTP/3 geralmente alcança os melhores resultados na prática.

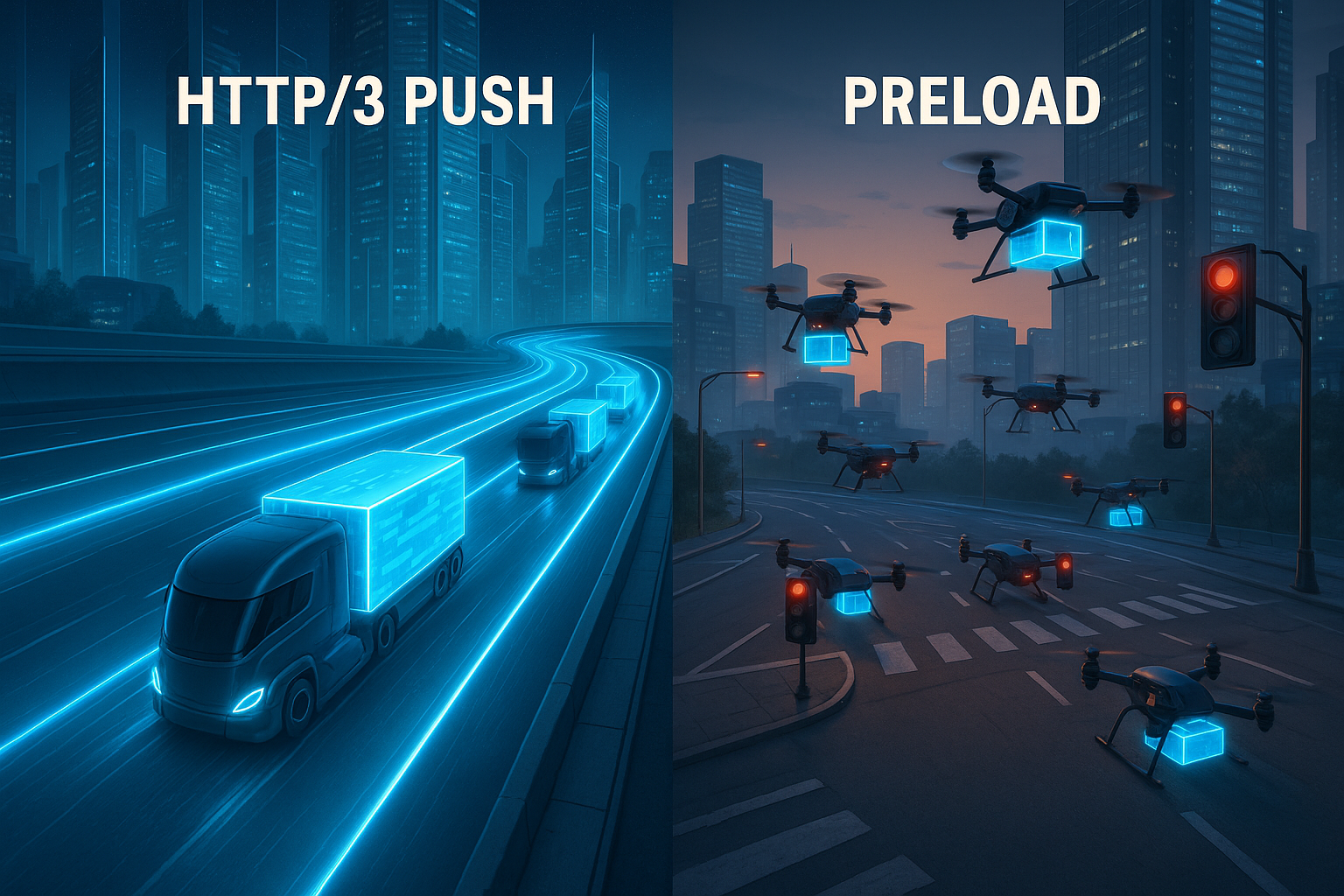

Explicação resumida do HTTP/3 Push e Preload

Eu defini Servidor Push quando o servidor fornece arquivos antes que o navegador os solicite, por exemplo, CSS, JS ou fontes da Web que são necessárias diretamente para a renderização. Essa tática coloca os recursos no cache logo no início, economiza viagens de ida e volta e pode favorecer visivelmente o First Contentful Paint. Pré-carga Por outro lado, uso tags de link na marcação para que o navegador saiba exatamente qual arquivo deve ser carregado primeiro. Isso cria prioridades claras, reduz as transferências duplicadas e funciona igualmente bem com HTTP/1.1, HTTP/2 e HTTP/3. Como o HTTP/3 é baseado no QUIC, vale a pena dar uma olhada no Protocolo QUIC, que trata os fluxos separadamente e, portanto, evita o congestionamento no nível da linha.

Como o HTTP/3 influencia o tempo de carregamento

Com o QUIC, o HTTP/3 elimina a Chefe de linha-O bloqueio, o que significa que as perdas de pacotes individuais não mais retardam o carregamento de todos os arquivos. Vários fluxos são executados em paralelo, e as perdas afetam apenas o fluxo afetado, o que é especialmente útil com muitos ativos. O 0-RTT pode acelerar as conexões se já houver um histórico, permitindo que as primeiras solicitações fluam mais rapidamente. O controle da potência de transmissão e da correção de erros também é adaptável, o que mantém a taxa de clock alta sob carga. Aqueles que apreciam comparações diretas encontrarão o HTTP/3 vs. HTTP/2 Comparação de desempenho: perspectivas adicionais sobre latência e comportamento de transferência.

Empurrar vs. pré-carregar: Lógica de decisão

Eu uso Empurre, quando é muito provável que um ativo seja necessário imediatamente, como a folha de estilo central ou um script acima da dobra. Nesses casos, a entrega proativa pode proporcionar uma economia de tempo visível, especialmente em redes móveis. No entanto, se o arquivo for enviado mesmo que o cliente já o tenha no cache ou não precise dele, isso desperdiça largura de banda e aumenta as filas para dados realmente importantes. Pré-carga Eu o utilizo quando quero controlar exatamente o que começa com prioridade e quando o analisador deve ver a solicitação. Isso mantém o controle em minhas mãos, evita transferências duplicadas e minimiza erros na seleção de recursos.

Comparação de desempenho em números

Em ambientes de medição com muitos downloads simultâneos, o HTTP/3 continua sendo significativamente mais eficiente, com perdas perceptíveis de mais de 8%. responsivo, enquanto o HTTP/2 cai [4]. Com arquivos de 1 MB e perda de 2%, os testes mostraram tempos de carregamento de cerca de 1,8 segundos com HTTP/1 em comparação com 1,2 segundos com HTTP/3 [5]. Essas diferenças têm um impacto direto sobre LCP, TTI e TBT, especialmente quando uma página solicita inicialmente muitos arquivos separados. No caso de aplicativos de página única e páginas de mídia, a separação de fluxos compensa especialmente porque um ativo com problemas não mais atrasa os outros. Eu sempre avalio os números no contexto de tipos de recursos, prioridades e acessos ao cache, porque é aí que está a maior alavancagem para a Velocidade.

| Critério | HTTP/3 Push | Pré-carga | Efeito sobre as métricas |

|---|---|---|---|

| Sistema de controle | No lado do servidor, proativo | Do lado do cliente, declarativo | Início antecipado vs. priorização clara |

| Risco de transferências duplas | Aumentado se o cache já estiver cheio | Baixo, conforme abordado com precisão | Influência na largura de banda e no TBT |

| Carga de rede/perda de pacotes | Perdas de buffers QUIC por fluxo [4] | Lucro por meio do nível de transporte HTTP/3 | Vantagens do LCP/INP sob carga |

| Taxa de acerto do cache | Os ativos impulsionados podem fracassar | Uso direcionado dos caches existentes | Redução do tempo de espera para pacientes que retornam |

| Esforço de implementação | Lógica necessária no servidor | Ajustes de marcação na cabeça | Lucro rápido com dependências claras |

Status do navegador em 2025: Push categorizado de forma realista

Ao planejar, levo em conta que muitos navegadores restringem severamente ou ignoram completamente o push na prática. Isso se aplica principalmente a cenários em que as transferências duplas são iminentes ou os caches já estão cheios. Como resultado, o push continua sendo uma arma especial para casos claramente definidos, como visitas iniciais em novas conexões, e não uma panaceia. Em minhas configurações, portanto, calculo o push como um impulsionador opcional e confio principalmente na pré-carga e na priorização limpa no nível do transporte. Quando os clientes não utilizam o push, recorro automaticamente ao pré-carregamento e às dicas antecipadas sem desestabilizar o pipeline. Essa priorização sóbria evita decepções e mantém o roadmap realista.

Dicas antecipadas (103) e pré-carga na equipe

Em vez de insistir cegamente, envio as configurações corretas Dicas iniciais (103) com Link: rel=preload antes do HTML real. Isso permite que o navegador inicie arquivos essenciais enquanto o servidor ainda está renderizando a página. Isso reduz o tempo até o primeiro byte dos ativos e, ao mesmo tempo, dá controle ao cliente. Na prática, isso funciona de forma confiável com o HTTP/3 e oferece muitas das vantagens do push, sem os riscos de transferências duplas.

HTTP/1.1 103 Dicas iniciais

Link: ; rel=preload; as=style; fetchpriority=high

Link: ; rel=modulepreload

HTTP/1.1 200 OK

...Eu uso o Early Hints principalmente para o CSS principal, fontes críticas da Web e módulos iniciais. Importante: O como-Os tipos devem corresponder exatamente para que não sejam acionadas solicitações duplicadas. Também me certifico de que as especificações CORS e os cabeçalhos de cache estejam definidos corretamente. Isso me permite aproveitar a maior parte das vantagens de um início antecipado sem que o servidor adivinhe demais.

Controle preciso de prioridades: cabeçalho de prioridade e fetchpriority

Além do Preload, eu confio em Sinais de prioridade em dois níveis:

- Em HTML via

prioridade de busca, Por exemplo.fetchpriority="high"para estilos ou imagens essenciais na janela de visualização efetchpriority="low"para ativos decorativos. - Sobre a resposta por meio de um cabeçalho de prioridade que fornece ao transporte informações claras sobre quais respostas devem ser priorizadas. Isso está em harmonia com o HTTP/3 e reduz a carga na linha quando há muitos fluxos paralelos.

É assim que eu trabalho em conjunto no lado do cliente e do servidor: O navegador toma as decisões corretas rapidamente e o servidor as fornece com a ponderação adequada. Em combinação com o QUIC, isso reduz a pressão sobre os gargalos e evita que arquivos insignificantes bloqueiem o caminho crítico.

Especifique a pré-carga com precisão

Muitos problemas com o pré-carregamento são causados por pequenas inconsistências. Eu as evito com uma marcação limpa e explícita:

Eu sempre verifico se o como-Os valores correspondem aos tipos de recursos reais. Para fontes origem cruzada Obrigatório, caso contrário, há o risco de downloads duplos. Para scripts, presto atenção ao modo (type="module" vs. clássico) e definir adiar, para que o analisador não bloqueie. Vejo o pré-carregamento como um complemento ao caminho de renderização, não como um substituto; a integração regular continua sendo necessária.

Detalhes da QUIC que contam na prática

Planejo o HTTP/3 com vistas a propriedades que são perceptíveis no campo:

- Migração de conexõesSe um dispositivo mudar de WLAN para rádio móvel, a conexão QUIC será mantida. Isso evita novos handshakes e evita que transferências longas sejam canceladas.

- QPACKCompactação de cabeçalho sem risco global de cabeçalho de linha. Isso acelera as páginas com muitas solicitações pequenas, especialmente em CDNs com muitos cabeçalhos recorrentes.

- 0-RTTEu só permito solicitações aceleradas antecipadas de recursos idempotentes e avalio a situação de segurança. Quando o 0-RTT entra em vigor, ganho um tempo notável durante o warm start.

- Controle adaptativo de congestionamentoO rendimento permanece mais estável em redes com perdas. Juntamente com a priorização, isso resulta em um comportamento robusto quando é importante.

Esses recursos só se tornam efetivos com uma configuração limpa do servidor e da CDN. Eu garanto TLS 1.3, cadeias de certificados curtas, informações de status de empilhamento e fallbacks coerentes para que os clientes mais antigos também possam ser atendidos com alto desempenho.

Usar corretamente a priorização de recursos

Eu defino Ativos principais claramente: o CSS crítico, as fontes para o texto visível e os scripts que afetam a área acima da dobra. Esses arquivos recebem a prioridade mais alta por meio de pré-carregamento ou são enviados em casos especiais. Os arquivos de imagem para conteúdo que será visível posteriormente recebem prioridade mais baixa ou são movidos para cima por meio de carregamento lento, de modo que o caminho de renderização e a interação estejam disponíveis antecipadamente. Para recursos de terceiros, avalio cuidadosamente os benefícios e defino a pré-conexão, se necessário, para que os handshakes comecem na hora certa. Isso deixa a linha livre para dados realmente importantes e evito que os ativos deco bloqueiem o início.

Na prática, mantenho uma rotina curta de tomada de decisões:

- O ativo é essencial para a FCP/LCP e quase sempre necessário? → Pré-carregamento, dicas iniciais opcionais; envio seletivo somente se for mensuravelmente superior.

- O uso é variável ou dependente do usuário? → Não há push; no máximo, o pré-carregamento é feito de acordo com a heurística testada ou com o carregamento posterior.

- O ativo é grande? → Prefira o pré-carregamento; empurre apenas se a largura de banda estiver garantida e os acessos ao cache forem improváveis.

- Existem alternativas, como CSS crítico em linha ou divisão de código? → Preferível; elas encurtam os caminhos e reduzem o risco geral.

Implementação: Lista de verificação da prática

Eu começo com um Auditoria da página inicial e dos modelos mais importantes e seleciono todos os arquivos necessários para a primeira área visível. Em seguida, crio entradas de pré-carregamento no cabeçalho, testo as prioridades e verifico se há solicitações duplicadas. Quando uma transferência antecipada vale muito a pena, considero o envio seletivo e meço o efeito no LCP e no TTI. Para QUIC/HTTP-3, ativo o suporte na CDN ou no servidor e comparo as regras de priorização com os caminhos críticos. Para obter ajuda passo a passo, utilizo um aplicativo prático Implementação do HTTP/3, para que a configuração, os testes e a implementação sejam executados de forma estruturada.

Também estabeleço as seguintes rotinas:

- Dicas iniciais e alimentá-lo com as mesmas entradas de link que o cabeçalho HTML final.

- Estratégia de cache com controle de versão:

app.abcdef.css, longoIdade máxima,imutável, para que os clientes que retornam se beneficiem. - Trabalhador de serviços para pré-carregar fluxos de modo que não haja duplicação de trabalho na rede e no cache do SW.

- Cabeçalho de prioridade na origem/CDN para que o HTTP/3 favoreça as respostas realmente importantes.

- Bandeiras de recursos para push/preload para executar testes A/B de forma rápida e sem riscos.

Erros típicos e como evitá-los

Eu não pressiono Ativos, que o navegador talvez já tenha em seu cache, pois isso desperdiça largura de banda. Em vez disso, verifico os cabeçalhos, a versão e a validade do cache para que os usuários que retornam se beneficiem de novos acessos. Não sobrecarrego o Preload, pois uma dúzia de entradas críticas pode obstruir a linha e diluir as prioridades. Com as fontes, presto atenção aos formatos adequados e às classificações de unicode para que a transferência permaneça enxuta e o texto visível apareça rapidamente. Também faço testes em diferentes dispositivos e redes sem fio, pois o verdadeiro efeito só se torna visível em condições reais.

Estou de olho nessas armadilhas em particular:

- Incompatibilidade entre

comoe o tipo de recurso (por exemplo.as="script"para módulos) → leva a requisitos secundários desnecessários. - Origem cruzada ausente para fontes → downloads duplos ou erros de bloqueio.

- Listas de pré-carregamento muito amplas → minar as prioridades; limito-me aos ativos principais.

- Funções pouco claras de Inline-Critical-CSS vs. Preload → Eu decido por página e evito formas mistas que sobrecarregam os dois lados.

- Empurrar às cegas sem conhecimento do cache → Push continua sendo uma aposta; eu meço e protejo com Early Hints.

Métodos de monitoramento e medição

Eu meço LCP, TTI, TBT e INP com o Lighthouse, adicionar dados de tempo de execução via RUM e comparar variantes usando testes A/B. O WebPageTest ou ferramentas semelhantes me ajudam a analisar diagramas de cascata e a reconhecer se o pré-carregamento e o push estão funcionando conforme planejado. A combinação de dados de laboratório e de campo mostra se as otimizações são viáveis ou geram efeitos colaterais. Verifico regularmente como os navegadores lidam com o push do servidor, pois alguns agentes de usuário restringem ou ignoram os ativos enviados [8]. Com base nesses dados, decido qual tecnologia deve ser implementada e qual deve ser retirada.

Eu diferencio por declarações confiáveis:

- Frio vs. quenteAvalie a primeira visita sem cache separadamente das visitas de retorno.

- Perfis de redeSimule 4G/5G com perdas realistas, cenários de alta RTT e células altamente utilizadas.

- Número de solicitaçõesExibição de páginas com poucos arquivos grandes versus muitos arquivos pequenos separadamente.

- Combinação de dispositivosDispositivos móveis de médio porte com uma CPU mais fraca, pois os custos de análise e descompressão são mais pesados.

Eu documento cada experimento com exatidão: versões de compilação, entradas de pré-carregamento, cabeçalhos de prioridade, regras de envio, status de dicas antecipadas. Isso me permite reproduzir os efeitos e revertê-los rapidamente, se necessário.

Hospedagem e infraestrutura como alavancagem

Eu presto atenção em Servidor com suporte atualizado a HTTP/3, configuração sólida de TLS e priorização limpa. Uma CDN de alto desempenho com boa cobertura de PoP reduz as latências para usuários móveis e torna os benefícios do QUIC mais tangíveis. A configuração limpa de fallbacks de TCP para clientes mais antigos também desempenha um papel importante para que ninguém fique em desvantagem. Para orçamentos, eu calculo o efeito primeiro, pois os menores ajustes de CDN ou ativações de HTTP/3 geralmente são suficientes sem altos custos adicionais na faixa baixa de dois dígitos de euros por mês. Quanto mais forte for a base, mais claros serão os efeitos do push e do pré-carregamento na vida cotidiana.

Também verifico se a infraestrutura suporta os seguintes pontos:

- Dicas iniciais do Edge para que os pré-carregamentos comecem antes do HTML.

- Priorização extensível ou cabeçalhos de prioridade que são respeitados pelo proxy.

- Regras detalhadas por caminho/tipo de arquivo para enviar apenas os ativos selecionados ou para destacá-los por meio de pré-carregamento.

- Métricas transparentes em nível de borda (taxa de acerto, RTT, perda, redefinição de prioridades) para tornar visíveis as causas dos desvios.

Categorização final

Estou vendo HTTP/3 com QUIC tem uma vantagem assim que redes sem fio, muitos fluxos paralelos ou situações de perda entram em jogo [4][5]. Em configurações controladas, o pré-carregamento fornece uma priorização confiável porque eu especifico exatamente o que realmente deve ser executado primeiro. Uso o push especificamente para recursos indispensáveis, cujos benefícios são consistentes e cujo tamanho permanece dentro dos limites. Obtenho o melhor efeito quando combino pré-carregamento para prioridades, HTTP/3 para transporte e push cuidadosamente dosado. Se proceder dessa forma, você reduzirá visivelmente os tempos de carregamento, protegerá a largura de banda do usuário e aumentará significativamente a qualidade percebida da página.