De nombreux sites web s'effondrent sous la charge parce que les WP Plugin Queries exécutent des dizaines de commandes de base de données répétitives à chaque appel de page, ce qui Base de données bloquer les requêtes. Je montre comment ces requêtes de plug-in WordPress sont créées, pourquoi les millisecondes individuelles par requête s'ajoutent aux secondes et comment je peux les réduire de manière mesurable.

Points centraux

- Cause: méta-requêtes répétées, modèles N+1 et indices manquants

- ReconnaissanceMesure avec les outils de requête et désactivation progressive

- impact: Mauvaise vitalité du core web, taux de rebond plus élevé

- MesuresAudit, maintenance de la base de données, mise en cache, réglage des requêtes

- À long terme: Plugins légers, transients propres, bon hébergement

Pourquoi les requêtes des plug-ins surchargent la base de données

Chaque plug-in lit ou écrit des données, mais plusieurs plug-ins ensemble génèrent rapidement des centaines de données. Requêtes par page. De nombreux outils lancent des requêtes identiques pour chaque post-ID au lieu de regrouper les résultats et de les mettre en cache. Je vois souvent des meta-looks sans index correspondants qui prennent 0,05 seconde ou plus par appel. Avec 50 requêtes, le temps d'attente est considérable, surtout si les visiteurs sont simultanés. Si des appels externes à l'API de fonctions sociales ou connexes viennent s'y ajouter, la performance s'effondre et les Temps de chargement augmente sensiblement.

Les causes en détail : boucles, méta et N+1

De nombreux plug-ins utilisent des boucles qui chargent des métadonnées pour chaque publication, un exemple typique N+1-modèle de requête. Au lieu d'utiliser une seule requête SQL, des dizaines de petits hits sont générés avec une durée d'exécution croissante. Les méta-requêtes sans index sur meta_key ou meta_value coûtent encore plus de temps. À cela s'ajoutent les looks d'options dans les options autoloaded, qui gonflent le chargement de wp_options. Je remplace de tels modèles de manière ciblée par des requêtes groupées et j'utilise si possible un Objet-cache.

Gérer correctement les requêtes de taxonomie et de terme

Outre le post-méta, les requêtes de taxinomie sont un deuxième moteur de charge souvent négligé. Dans les archives et les widgets, j'interroge souvent des termes, des comptages ou des articles liés. Lorsque les plugins exécutent des appels get_terms individuels par terme ou chargent séparément les posts par terme, il en résulte à nouveau N+1. C'est pourquoi je regroupe les ID de terme via des listes IN(), je charge les relations correspondantes en une seule fois et je désactive le préchargement inutile.

- Je mise sur wp_term_relationships et wp_term_taxonomie sur des index appropriés (term_taxonomy_id, term_id), afin que les JOINs ne soient pas exécutés en Full Scans.

- À l'adresse suivante : get_terms je réduis les champs au strict minimum (par exemple uniquement les ID) si je n'ai pas besoin de noms ou de slugs par la suite.

- J'évite les recherches LIKE via Slugs et j'évite ORDER BY RAND(), qui trie complètement les listes et rend les tableaux temporairement grands.

- Pour les taxonomies hiérarchiques, je mets en cache les arbres calculés de manière agressive afin que les structures profondes ne soient pas créées de manière récursive à chaque appel de page.

Conflits, redondance et tables orphelines

Si j'installe des doubles fonctions, par exemple plusieurs modules d'analyse ou de référencement, les coûts se multiplient. Requêtes sont inutiles. De même, les widgets qui effectuent un rendu sur chaque page redemandent constamment des données. Les plug-ins désactivés laissent souvent des tableaux qui ralentissent les sauvegardes, les exportations et la maintenance. Je vérifie régulièrement quelles tables sont orphelines et je les nettoie systématiquement. Je réduis ainsi la charge inutile et gagne sensiblement en efficacité. Vitesse.

Effets de la croissance : Révisions, transitoires et spam

Avec le temps, chaque installation se gonfle : Les post-révisions, les transients qui expirent et les commentaires de spam s'accumulent comme des Ballast à la fin de la journée. De nombreux plugins créent en outre leurs propres tables et ne les nettoient jamais automatiquement. Je planifie donc des fenêtres de maintenance fixes et je supprime les révisions historiques, les anciens transients et les déchets dans les commentaires. Je donne ici un aperçu plus approfondi de ces entrées temporaires : Transients expliqué. Ces cycles de nettoyage permettent d'alléger la base de données et de réduire la durée moyenne de conservation des données. Durée de la requête.

mesure : comment trouver des plugins wp slow

Je commence toujours par mesurer avant de modifier quoi que ce soit, et j'utilise pour cela l'analyse de requête directement dans le Backend. Cela me montre par page quelles requêtes sont en cours et pendant combien de temps, et quel plugin les déclenche. Pour l'analyse détaillée, je m'appuie sur le guide suivant : Moniteur de requêtes. Ensuite, je désactive des groupes de plugins à titre d'essai, je recharge la page et je compare les chiffres. Je vois ainsi rapidement quels plugins wp slow coûtent du temps réel et où je dois commencer par Latence d'appuyer sur le bouton.

Fonctions de recherche, pagination et archives

La recherche et les pages d'archives font partie des domaines qui nécessitent le plus de requêtes. J'optimise WP_Query de manière ciblée via des paramètres : Si je n'ai besoin que d'ID, je ne charge pas d'objets postaux complets. Sur les pages de recherche et de listing, je désactive le calcul du nombre total si je ne dois de toute façon pas afficher la pagination avec les numéros de page.

- no_found_rows: mettre true si le nombre total d'occurrences n'est pas nécessaire - cela permet d'économiser des COUNTs coûteux.

- champs: utiliser ‚ids‘ si un batch en aval charge les détails ou si je n'ai besoin que de références.

- update_post_meta_cache et update_post_term_cache: à false pour les listes qui n'affichent que des titres/permaliens.

- Recherche LIKE de désamorcer le problème : Je limite les termes de recherche, je nettoie les jokers et j'envisage des index FULLTEXT si cela correspond au contenu.

- Illimité Pagination j'évite : je fixe des longueurs de page raisonnables et des limites supérieures strictes pour les décalages afin de ne pas tomber dans des scans profonds.

Impact sur les performances et le référencement

Les temps de réponse longs détériorent le First Byte Time et tirent la Noyau Web Vitals vers le bas. À partir de trois secondes de retard, le taux de rebond augmente nettement et les signaux envoyés aux moteurs de recherche basculent. J'oriente chaque optimisation vers un objectif inférieur à 2,5 secondes et je mesure avant et après chaque modification. La mise en cache amortit beaucoup, mais les requêtes inefficaces restent un risque en cas de cache-miss. C'est pourquoi je résous la cause et pas seulement le Symptômes.

Sélection des plugins : Éviter les antipatterns de performance

Je choisis les plugins en fonction des fonctionnalités requises et des coûts de fonctionnement, et non en fonction de la richesse des fonctionnalités ou de l'utilisation. Confort. Je remplace souvent les gros plug-ins de suite par un module léger avec une tâche claire. Je résume dans ce billet les antipatterns typiques qui font perdre du temps : Antipatterns de performance. Avant chaque installation, je vérifie le changelog, les tables de la base de données et si le plugin respecte la mise en cache côté serveur. J'évite ainsi une charge supplémentaire, je réduis les dépendances et je maintiens les Requêtes sous contrôle.

WooCommerce, adhésions et données complexes

Les boutiques, les systèmes d'adhésion et les systèmes LMS renforcent tous les modèles : plus tableaux, plus de jointures, plus d'écritures. Dans WooCommerce, je vérifie si les données de commande et de produit sont interrogées efficacement, si les carts et les fragments ne doivent pas être créés dynamiquement sur chaque page et si des index combinés sont disponibles sur les filtres fréquemment utilisés (statut, date, client). Les grands tableaux post-meta freinent particulièrement : je mise autant que possible sur des schémas allégés et j'évite que chaque plugin écrive ses propres métadonnées de produits redondantes.

- Je minimise Consultations en direct dans le checkout et cache les éléments du catalogue (règles de prix, disponibilités) avec une invalidation claire en cas de modification.

- Je fais en sorte que les widgets du tableau de bord dans les zones d'administration ne recalculent pas les statistiques complètes à chaque appel.

- Je réduis les intervalles AJAX (par ex. Cart-Refresh) et je mets en place des timeouts durs et des stratégies de backoff pour que les pics d'erreurs n'inondent pas la DB.

WP-Cron, jobs d'arrière-plan et limitation de débit

Les tâches d'arrière-plan passent souvent inaperçues - jusqu'à ce qu'elles soient toutes exécutées en même temps pendant les heures d'utilisation principale. Je répartis les tâches Cron sur la journée, je limite la taille des lots et je veille à ce que Verrouillage, pour que les tâches ne démarrent pas deux fois. Les exportations, les synchronisations et les créations de rapports se déroulent chez moi en différé et de préférence en dehors des pics de trafic. En outre, je fixe une limite de débit pour les requêtes externes afin que les erreurs d'API ne déclenchent pas de cascades.

Optimisation des requêtes : index et traitement par lots

J'analyse les énoncés lents, vérifie la sortie EXPLAIN et place les énoncés appropriés. Indices. S'il manque un index sur meta_key ou sur des colonnes combinées, la durée d'exécution est fortement réduite en fonction de la taille. En outre, je regroupe les requêtes individuelles répétées en une requête groupée. Là où un plugin génère N+1, je remplace la boucle par un preload de tous les ID nécessaires. Avec un traitement par lots propre et de bons index, le nombre de requêtes et la durée moyenne de traitement diminuent. Durée perceptible.

Approfondir la mesure : Slow Query Log, EXPLAIN et APM

En plus de l'analyse de surface, je vais plus loin : j'active le journal des requêtes lentes avec un seuil significatif et je ne regarde pas seulement les temps purs, mais aussi la fréquence. Une requête rapide qui s'exécute mille fois par page est une plus grande Levier qu'une seule valeur aberrante. J'utilise la sortie EXPLAIN au format JSON pour identifier clairement l'utilisation des clés, les stratégies de jointure et les tables temporaires. En complément, j'observe via les traces APM si les temps d'exécution PHP ou les temps d'attente réseau se déroulent en parallèle et expliquent la durée totale.

Mise en cache d'objets, Redis et hébergement

Un cache d'objets conserve les résultats des recherches récurrentes. Requêtes dans la mémoire de travail et réduit immédiatement la charge. Dans de nombreuses configurations, quelques minutes de TTL suffisent pour lisser les pics et livrer les pages rapidement de manière dynamique. Je vérifie alors si les plugins définissent et invalident correctement les données transitoires. En outre, j'active le cache de page, minimise les options d'autoload et utilise PHP 8+ pour une exécution plus rapide. Cette combinaison réduit de manière significative le taux de requêtes et augmente la vitesse d'exécution. Temps de réaction en charge.

Moteur de base de données et configuration

Outre le code, la Configuration de la BD un facteur de performance. Je choisis InnoDB avec un buffer pool suffisamment grand pour que les données à chaud restent dans la RAM. Je dimensionne les tampons temporaires et de tri de manière à ce que les tries et GROUP BY fréquents ne doivent pas être déplacés sur le disque. J'utilise utf8mb4 pour une compatibilité Unicode totale et des collations cohérentes, afin que les comparaisons restent prévisibles et favorables à l'index. Je choisis des stratégies d'autocommit et de flush en fonction des exigences de persistance, sans compromettre la sécurité des données.

- Je surveille tmp tables sur disque et j'ajuste les seuils pour que les gros tris ne paginent pas constamment dans les fichiers.

- Je garde un œil sur le nombre de connexions simultanées et je mise sur le pooling de connexions par le gestionnaire PHP plutôt que sur des limites de BD extrêmement élevées.

- Je prévois des fenêtres ANALYZE/OPTIMIZE régulières lorsque les statistiques deviennent obsolètes ou que les tableaux se fragmentent fortement - avec prudence et suivi.

Cache d'objets : clés, TTL et invalidation

La qualité d'une cache dépend de sa Invalidation. Je définis les clés de cache de manière cohérente (ID de site, langue, contexte utilisateur) et j'évite les trichages du cache grâce à des TTL courts et échelonnés et au verrouillage. Après les mises à jour de contenu, je supprime de manière ciblée les clés concernées au lieu de tout rejeter globalement. Résultat : moins de démarrages à froid, des temps de réponse plus stables et une charge de requêtes nettement plus faible.

- Je fais la distinction entre les groupes persistants et non persistants et je compresse les charges utiles volumineuses si nécessaire.

- Je prime les caches critiques après les déploiements afin que le premier utilisateur ne paie pas la totalité des droits de construction.

- Je veille à ce que les transients ne soient pas utilisés comme solution permanente lorsqu'un véritable cache d'objets est disponible.

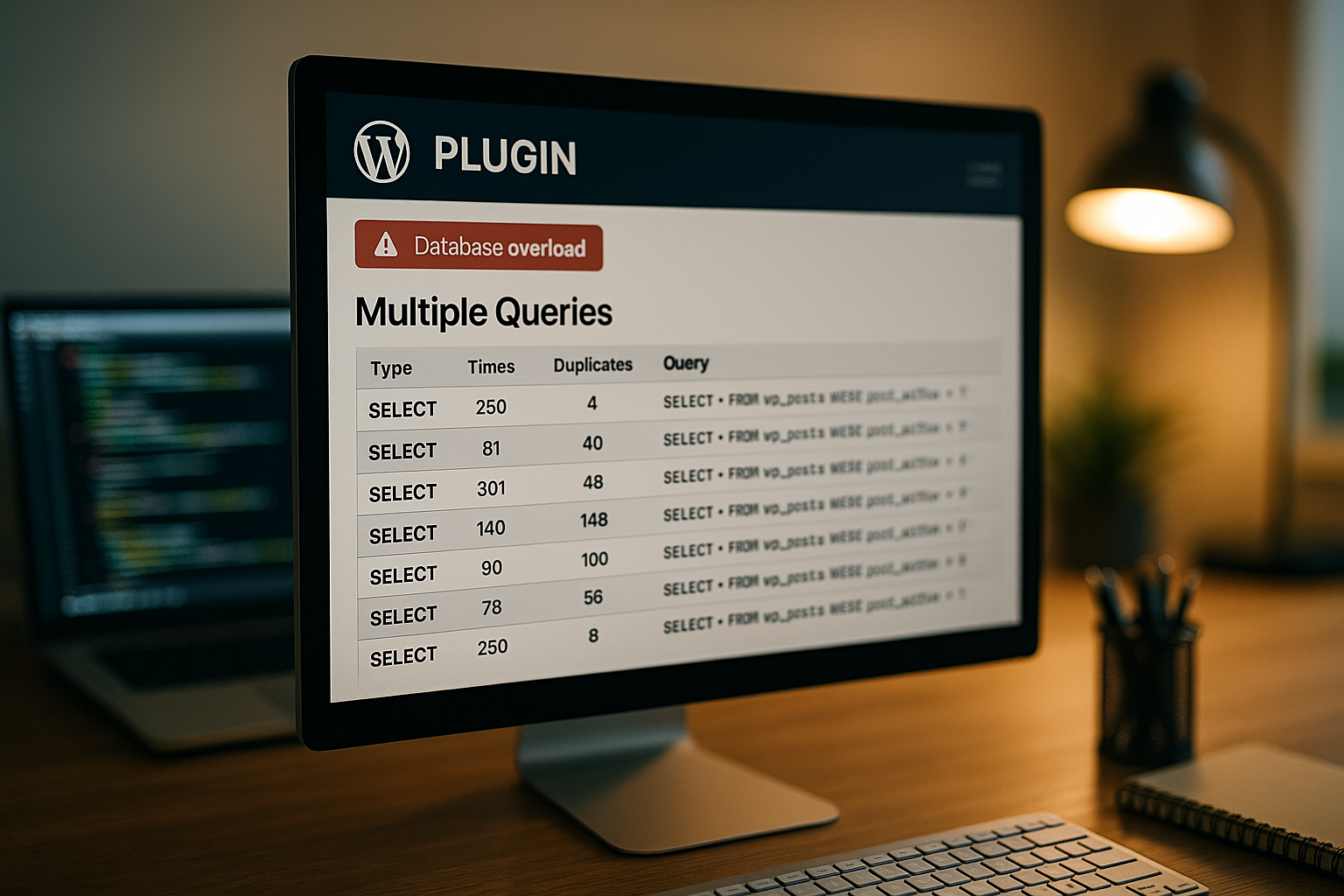

Tableau : facteurs de coûts et fixes

L'aperçu suivant montre les inducteurs de coûts typiques, leurs effets et ce que je fais concrètement pour les éviter Dernier de réduire les coûts.

| Type de problème | Requête typique / modèle | Séquence | Réparation rapide | Effet permanent |

|---|---|---|---|---|

| Méta N+1 | get_post_meta par courrier | Beaucoup de petits hits | Chargement par lot par IN() | Moins de Requêtes |

| Pas d'index | meta_key LIKE ‚%‘ (clé de l'objet)‘ | Balayage complet de la table | Index sur meta_key | plus court Durée de validité |

| Blocage de l'autoload | wp_options gonflées | TTFB plus élevé | Réduire l'autoload | Plus rapide Chargement |

| Appels externes | API par page consultée | Temps d'attente bloquant | Mise en cache côté serveur | constante Réponse |

| Transients-Corps | Expiré, mais disponible | Plus de volume DB | Déblayer régulièrement | Plus mince Données |

Mise à l'échelle : Read-Replicas et Edge-Caching

Lorsque l'optimisation ne suffit plus, je passe à l'échelle : les réplicas de lecture découplent la charge de lecture de la charge d'écriture, à condition que je comprenne les latences de réplication et que je continue à router les chemins critiques en écriture (checkout, commentaires) vers le système maître. Les caches Edge et Page réduisent drastiquement les requêtes dynamiques pour les utilisateurs anonymes. Il est important d'avoir un concept d'invalidation clair afin que les modifications de contenu soient rapidement visibles sans devoir vider complètement le cache.

- J'identifie vraiment statique les parties de la page (navigation, pied de page, listes) et les cache plus longtemps, les zones dynamiques plus brièvement.

- Je sépare clairement le contexte de l'utilisateur : les utilisateurs connectés évitent le cache des pages, mais bénéficient du cache des objets et de requêtes allégées.

- J'observe les retards de réplication et je maintiens une cohérence stricte des actions liées à la sécurité.

Modèles de code robustes dans les plug-ins

Un bon code évite automatiquement les pics de charge. J'écris toujours des requêtes préparées et je limite sévèrement les quantités de résultats. Pour les tâches répétitives, j'utilise des services dédiés plutôt que des hooks éparpillés qui tirent plusieurs fois. Lors de la désinstallation, je nettoie les données afin de ne pas laisser d'orphelins.

- Déclarations préparées avec un typage propre ; pas de fragments SQL dynamiques sans escapade.

- SELECT limités avec ORDER/WHERE sur des colonnes indexées ; mises à jour importantes en lots plutôt qu'en une seule transaction sur plusieurs secondes.

- pre_get_posts utiliser avec parcimonie et en fonction du contexte, afin que chaque requête ne reçoive pas globalement des filtres supplémentaires.

- REST/AJAX Points finaux avec mise en cache, délais d'attente et backoff ; pas d'intervalles de quelques secondes pour le polling.

- Routines de désinstallation qui suppriment systématiquement les tables, les options et les transitoires.

Un plan pas à pas pour des résultats rapides

Je mesure d'abord le statu quo et sécurise les chiffres pour les requêtes, le TTFB et les données complètes. Temps de chargement. Ensuite, je désactive les plugins similaires à des fonctions, je supprime les tables orphelines et je réduis les options d'autoload. Dans la troisième étape, j'optimise les plus grandes requêtes lentes grâce aux index et au batching. Ensuite, j'active les caches de pages et d'objets et je définis des TTL judicieux afin que les échecs de cache restent rares. Enfin, je teste des scénarios réels, j'observe les journaux d'erreurs et je peaufine les détails jusqu'à ce que les indicateurs soient stables et dans le vert. Domaine sont couchés.

Résumé

Les plugin queries de WP deviennent un frein lorsque les boucles, les index manquants et les plugin doppler Requêtes gonfler le nombre de pages. Je résous cela par la mesure, l'audit ciblé des plugins, la maintenance de la base de données, le réglage des requêtes et la mise en cache. Je réduis ainsi les demandes, diminue les temps de réponse et maintiens Core Web Vitals dans la zone verte. La clé réside dans des responsabilités claires par plugin et des audits réguliers, plutôt que dans des mesures individuelles frénétiques. En suivant cette feuille de route, on obtient des résultats tangibles. Tempo à partir de n'importe quelle installation WordPress.