Wiele witryn zapada się pod obciążeniem, ponieważ zapytania wtyczek WP wykonują dziesiątki powtarzających się poleceń bazy danych przy każdej odsłonie strony, spowalniając w ten sposób działanie witryny. Baza danych blok. Pokażę ci, jak tworzone są te zapytania wtyczki WordPress, dlaczego poszczególne milisekundy na zapytanie sumują się do sekund i jak mogę je wymiernie zmniejszyć.

Punkty centralne

- PrzyczynaPowtarzające się metapytania, wzorce N+1 i brakujące indeksy

- UznaniePomiar za pomocą narzędzi zapytań i dezaktywacja krok po kroku

- WpływSłabe podstawowe parametry sieci, wyższy współczynnik odrzuceń

- ŚrodkiAudyt, utrzymanie bazy danych, buforowanie, dostrajanie zapytań

- DługoterminowyChude wtyczki, czyste transjenty, dobry hosting

Dlaczego zapytania wtyczek przeciążają bazę danych

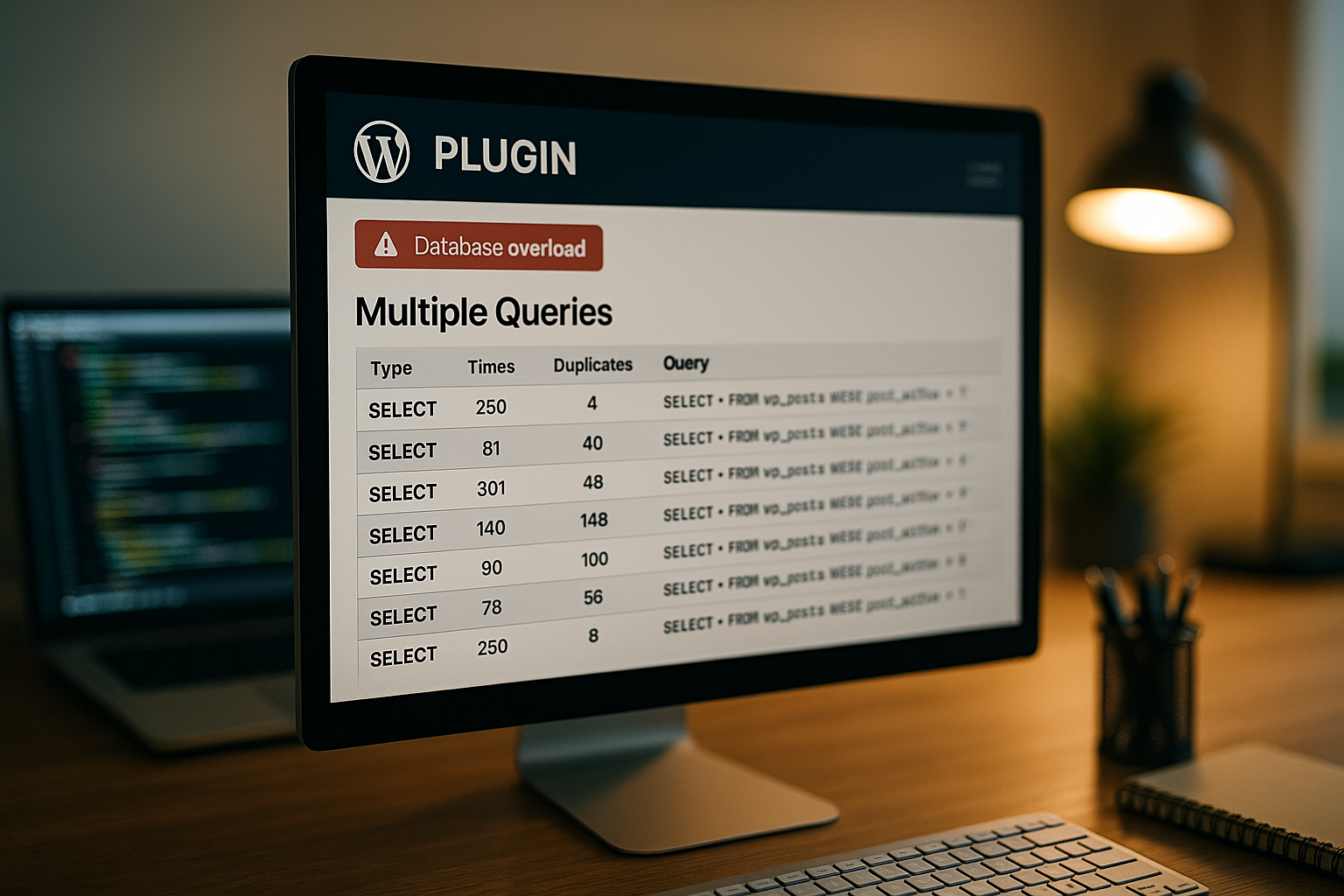

Każda wtyczka odczytuje lub zapisuje dane, ale kilka wtyczek razem może szybko wygenerować setki rekordów danych. Zapytania na stronę. Wiele narzędzi wysyła identyczne zapytania dla każdego identyfikatora posta, zamiast łączyć i buforować wyniki. Często widzę meta wyszukiwania bez pasujących indeksów, które zajmują 0,05 sekundy lub dłużej na zapytanie. Przy 50 zapytaniach daje to zauważalny czas oczekiwania, zwłaszcza w przypadku jednoczesnych odwiedzających. Po dodaniu zewnętrznych wywołań API z funkcji społecznościowych lub powiązanych funkcji, wydajność spada na kolana, a Czas załadunku znacznie wzrasta.

Przyczyny w szczegółach: Pętle, Meta i N+1

Wiele wtyczek używa pętli, które ładują metadane dla każdego postu indywidualnie, typowy N+1-pattern. Zamiast używać pojedynczego zapytania SQL, tworzone są dziesiątki małych trafień z rosnącym czasem wykonania. Zapytania meta bez indeksu na meta_key lub meta_value kosztują dodatkowy czas. Ponadto w automatycznie ładowanych opcjach znajdują się wyszukiwania opcji, które zwiększają obciążenie wp_options. Specjalnie zastępuję takie wzorce zapytaniami wiązanymi i używam rozszerzenia Obiekt-Cache.

Prawidłowa obsługa taksonomii i zapytań o terminy

Oprócz meta postów, zapytania dotyczące taksonomii są drugim, często pomijanym czynnikiem obciążającym. Często pytam o terminy, liczby lub połączone posty w archiwach i widżetach. Jeśli wtyczki wykonują indywidualne wywołania get_terms dla każdego terminu lub ładują posty osobno dla każdego terminu, skutkuje to kolejnym N+1. Dlatego podsumowuję identyfikatory terminów za pomocą list IN(), ładuję powiązane relacje za jednym razem i dezaktywuję niepotrzebne wstępne ładowanie.

- Używam wp_term_relationships oraz wp_term_taxonomy do odpowiednich indeksów (term_taxonomy_id, term_id), aby JOIN nie były uruchamiane w pełnym skanowaniu.

- Na stronie get_terms Redukuję pola do niezbędnego minimum (np. tylko ID), jeśli nie potrzebuję później nazw lub slug.

- Unikam wyszukiwania LIKE za pomocą slug i unikam ORDER BY RAND(), które całkowicie sortuje listy i tymczasowo powiększa tabele.

- W przypadku hierarchicznych taksonomii agresywnie buforuję obliczone drzewa, aby głębokie struktury nie były generowane rekurencyjnie przy każdej odsłonie strony.

Konflikty, nadmiarowość i osierocone tabele

Jeśli zainstaluję podwajacze funkcji, takie jak kilka modułów analitycznych lub SEO, wówczas Zapytania niepotrzebne. Widżety, które renderują się na każdej stronie, również stale żądają nowych danych. Dezaktywowane wtyczki często pozostawiają po sobie tabele, które spowalniają tworzenie kopii zapasowych, eksport i konserwację. Regularnie sprawdzam, które tabele są osierocone i konsekwentnie je porządkuję. W ten sposób zmniejszam niepotrzebne obciążenie i osiągam zauważalne korzyści Prędkość.

Efekty wzrostu: Korekty, stany nieustalone i spam

Z czasem każda instalacja się rozrasta: Wersje postów, wygasające transienty i komentarze spamowe kumulują się jak Balast do. Wiele wtyczek tworzy również własne tabele i nigdy nie czyści ich automatycznie. Dlatego planuję stałe okna konserwacyjne i usuwam historyczne wersje, stare stany przejściowe i śmieci w komentarzach. Więcej informacji na temat tych tymczasowych wpisów można znaleźć tutaj: Wyjaśnienie stanów nieustalonych. Te rundy czyszczenia utrzymują bazę danych w dobrej kondycji i zmniejszają średnią wartość Czas zapytania.

Pomiar: Jak znaleźć powolne wtyczki wp

Zawsze zaczynam od pomiaru, zanim cokolwiek zmienię i używam analizy zapytań bezpośrednio w Backend. To pokazuje mi, które zapytania działają jak długo na każdej stronie i która wtyczka je uruchamia. Do szczegółowej analizy używam następującego przewodnika: Monitor zapytań. Następnie dezaktywuję grupy wtyczek jako test, ponownie ładuję stronę i porównuję liczby. To pozwala mi szybko zobaczyć, które powolne wtyczki wp kosztują rzeczywisty czas i od czego powinienem zacząć, aby zoptymalizować stronę. Opóźnienie nacisnąć.

Funkcje wyszukiwania, paginacja i archiwa

Strony wyszukiwania i archiwów należą do obszarów o największym natężeniu zapytań. Optymalizuję WP_Query w szczególności poprzez parametry: Jeśli potrzebuję tylko identyfikatorów, nie ładuję pełnych obiektów postów. Na stronach wyszukiwania i listingu dezaktywuję określanie całkowitej liczby, jeśli i tak nie muszę wyświetlać paginacji z numerami stron.

- no_found_rowsUstaw : true jeśli całkowita liczba trafień nie jest wymagana - oszczędza to kosztownych COUNT.

- polaUżyj ‚ids‘, jeśli kolejna partia ładuje szczegóły lub jeśli potrzebuję tylko referencji.

- update_post_meta_cache oraz update_post_term_cachedla list, które wyświetlają tylko tytuły/permalinki, ustawiona na false.

- Wyszukiwanie LIKE defuse: Ograniczam wyszukiwane hasła, czyszczę symbole wieloznaczne i rozważam indeksy FULLTEXT, jeśli pasuje to do treści.

- Bez ograniczeń Paginacja Unikam: Ustawiam rozsądne długości stron i twarde górne limity przesunięć, aby uniknąć głębokiego skanowania.

Wpływ na wydajność i SEO

Długie czasy odpowiedzi pogarszają czas pierwszego bajtu i spowalniają działanie. Rdzeń Web Vitals w dół. Od opóźnienia wynoszącego trzy sekundy współczynnik odrzuceń znacznie wzrasta, a sygnały dla wyszukiwarek są tracone. Celem każdej optymalizacji jest mniej niż 2,5 sekundy i pomiar przed i po każdej zmianie. Buforowanie dużo buforuje, ale nieefektywne zapytania pozostają ryzykiem związanym z brakami w pamięci podręcznej. Dlatego też rozwiązuję przyczynę, a nie tylko skutek. Objawy.

Wybór wtyczek: Unikanie wzorców wydajności

Wybieram wtyczki zgodnie z wymaganiami funkcjonalnymi i kosztami uruchomienia, a nie według funkcjonalności lub Wygoda. Często zastępuję duże wtyczki pakietowe lekkimi modułami z jasnym zadaniem. W tym artykule podsumowałem typowe anty-wzorce, które kosztują czas: Anty-wzorce wydajności. Przed każdą instalacją sprawdzam dziennik zmian, tabele bazy danych i czy wtyczka respektuje buforowanie po stronie serwera. W ten sposób unikam dodatkowego obciążenia, zmniejszam zależności i utrzymuję Zapytania w ryzach.

WooCommerce, członkostwo i złożone dane

Sklepy, systemy członkowskie i LMS wzmacniają wszystkie wzorce: więcej Tabele, więcej złączeń, więcej zapisów. W WooCommerce sprawdzam, czy dane o zamówieniach i produktach są wyszukiwane wydajnie, czy koszyki i fragmenty nie muszą być tworzone dynamicznie na każdej stronie i czy dostępne są połączone indeksy dla często używanych filtrów (status, data, klient). Duże tabele meta postów są szczególną przeszkodą: używam szczupłych schematów tam, gdzie to możliwe i unikam pisania przez każdą wtyczkę własnych zbędnych metadanych produktu.

- Minimalizuję Zapytania na żywo w kasie i buforować elementy katalogu (zasady cenowe, dostępność) z wyraźnym unieważnieniem w przypadku zmian.

- Upewniam się, że widżety pulpitu nawigacyjnego w obszarach administracyjnych nie przeliczają pełnych statystyk za każdym razem, gdy są wywoływane.

- Zmniejszam interwały AJAX (np. odświeżanie koszyka) i ustawiam twarde timeouty i strategie backoff, aby zapobiec zalewaniu bazy danych przez błędy.

WP-Cron, zadania w tle i ograniczanie szybkości

Zadania w tle są często niepozorne - dopóki wszystkie nie zostaną uruchomione w tym samym czasie w godzinach największego obciążenia. Rozdzielam zadania cron w ciągu dnia, ograniczam rozmiary partii i upewniam się, że Blokada, aby zadania nie uruchamiały się dwukrotnie. Eksporty, synchronizacje i generowanie raportów uruchamiam z opóźnieniem i najlepiej poza szczytami ruchu. Ustawiam również ograniczenie szybkości dla żądań zewnętrznych, aby błędy API nie powodowały kaskad.

Optymalizacja zapytań: indeksy i batching

Analizuję powolne instrukcje, sprawdzam dane wyjściowe EXPLAIN i ustawiam odpowiednie Wskaźniki. Jeśli nie ma indeksu na meta_key lub połączonych kolumnach, czas działania będzie znacznie krótszy w zależności od rozmiaru. Ponadto łączę powtarzające się pojedyncze zapytania w jedno zapytanie zbiorcze. Tam, gdzie wtyczka generuje N+1, zastępuję pętlę wstępnym ładowaniem wszystkich wymaganych identyfikatorów. Dzięki czystemu wsadowaniu i dobrym indeksom liczba zapytań i średni czas działania są zmniejszone. Czas trwania zauważalne.

Pogłębione pomiary: Slow Query Log, EXPLAIN i APM

Oprócz analizy powierzchniowej, wchodzę głębiej: aktywuję dziennik powolnych zapytań z rozsądnym progiem i patrzę nie tylko na czyste czasy, ale także na częstotliwość. Szybkie zapytanie, które uruchamia się tysiące razy na stronę, jest większym zapytaniem. Dźwignia niż pojedyncza wartość odstająca. Używam danych wyjściowych EXPLAIN w formacie JSON, aby wyraźnie rozpoznać użycie kluczy, strategie łączenia i tabele tymczasowe. Ponadto korzystam ze śladów APM, aby zaobserwować, czy czasy wykonywania PHP lub opóźnienia sieciowe działają równolegle i wyjaśnić całkowity czas trwania.

Buforowanie obiektów, Redis i hosting

Pamięć podręczna obiektów przechowuje wyniki powtarzających się operacji Zapytania w pamięci roboczej i natychmiast zmniejsza obciążenie. W wielu konfiguracjach wystarczy kilka minut TTL, aby wygładzić szczyty i dostarczać strony dynamicznie i szybko. Sprawdzam, czy wtyczki poprawnie ustawiają i unieważniają dane przejściowe. Aktywuję również pamięć podręczną strony, minimalizuję opcje autoload i używam PHP 8+ do szybszego wykonywania. Ta kombinacja znacznie zmniejsza częstotliwość zapytań i zwiększa wydajność. Czas reakcji pod obciążeniem.

Silnik bazy danych i konfiguracja

W uzupełnieniu do kodu Konfiguracja DB czynnik wydajności. Wybieram InnoDB z wystarczająco dużą pulą buforów, aby gorące dane pozostały w pamięci RAM. Rozmiar bufora tymczasowego i bufora sortowania dobieram tak, by częste sortowania i GROUP BY nie musiały być przenoszone na dysk. Używam utf8mb4 dla pełnej zgodności z Unicode i spójnych kolacji, aby porównania pozostały przewidywalne i przyjazne dla indeksów. Wybieram strategie autocommit i flush w zależności od wymagań trwałości bez narażania bezpieczeństwa danych.

- I monitor tabele tmp na dysku i dostosuj wartości progowe, aby duże sortowania nie były stale zamieniane na pliki.

- Pilnuję liczby jednoczesnych połączeń i polegam na puli połączeń za pośrednictwem obsługi PHP zamiast ekstremalnie wysokich limitów DB.

- Planuję regularne okna ANALYZE/OPTIMIZE, gdy statystyki stają się nieaktualne lub tabele stają się mocno pofragmentowane - z zachowaniem ostrożności i monitorowania.

Pamięć podręczna obiektów: klucze, TTL i unieważnianie

Pamięć podręczna jest tak dobra, jak jej Unieważnienie. Spójnie definiuję klucze pamięci podręcznej (identyfikator witryny, język, kontekst użytkownika) i zapobiegam stemplowaniu pamięci podręcznej za pomocą krótkich, rozłożonych w czasie czasów TTL i blokowania. Po aktualizacji zawartości usuwam klucze, których to dotyczy, zamiast odrzucać wszystko globalnie. Rezultat: mniej zimnych startów, bardziej stabilne czasy odpowiedzi i znacznie niższe obciążenie zapytaniami.

- Rozróżniam grupy trwałe i nietrwałe i w razie potrzeby kompresuję duże ładunki.

- Przygotowuję krytyczne pamięci podręczne po wdrożeniu, aby pierwszy użytkownik nie ponosił pełnych kosztów instalacji.

- Upewniam się, że transienty nie są nadużywane jako stałe rozwiązanie, gdy dostępna jest prawdziwa pamięć podręczna obiektów.

Tabela: Czynniki kosztowe i koszty stałe

Poniższy przegląd pokazuje typowe czynniki kosztotwórcze, ich wpływ i to, co konkretnie robię, aby je zminimalizować. Obciążenie obniżyć.

| Typ problemu | Typowe zapytanie / wzorzec | Konsekwencje | Szybka naprawa | Trwały efekt |

|---|---|---|---|---|

| Meta N+1 | get_post_meta per post | Wiele małych trafień | Ładowanie wsadowe przez IN() | Mniej Zapytania |

| Brak indeksu | meta_key LIKE ‚%‘ | Pełne skanowanie tabeli | Indeks na meta_key | Krótszy Czas działania |

| Autoload-Bloat | Zawyżone wp_options | Wyższe TTFB | Ograniczenie automatycznego ładowania | Szybciej Ładowanie |

| Połączenia zewnętrzne | Interfejsy API na odsłonę | Blokowanie czasu oczekiwania | Buforowanie po stronie serwera | Stała Odpowiedź |

| Przejściowe zwłoki | Wygasły, ale dostępny | Większy wolumen DB | Czyść regularnie | Szczuplejszy Dane |

Skalowanie: repliki odczytu i buforowanie brzegowe

Gdy optymalizacja przestaje wystarczać, skaluję: repliki odczytu oddzielają obciążenia odczytu i zapisu, pod warunkiem, że rozumiem opóźnienia replikacji i nadal kieruję ścieżki krytyczne dla zapisu (checkout, komentarze) do systemu głównego. Pamięci podręczne krawędzi i stron drastycznie redukują dynamiczne zapytania dla anonimowych użytkowników. Jasna koncepcja unieważniania jest ważna, aby zmiany treści stały się szybko widoczne bez całkowitego opróżniania pamięci podręcznej.

- Naprawdę się identyfikuję statyczny części strony (nawigacja, stopka, listy) i buforować je dłużej, obszary dynamiczne krócej.

- Wyraźnie oddzielam kontekst użytkownika: zalogowani użytkownicy omijają pamięć podręczną strony, ale korzystają z pamięci podręcznej obiektów i zapytań lean.

- Monitoruję opóźnienia replikacji i utrzymuję spójność działań związanych z bezpieczeństwem.

Solidne wzorce kodu we wtyczkach

Dobry kod automatycznie unika szczytów obciążenia. Zawsze piszę zapytania z wyprzedzeniem i ustawiam twarde limity dla zestawów wyników. W przypadku powtarzających się zadań używam dedykowanych usług zamiast rozproszonych haków, które uruchamiają się wiele razy. Podczas odinstalowywania porządkuję dane, aby nie pozostawić po sobie sierot.

- Przygotowane instrukcje z czystym typowaniem; bez dynamicznych fragmentów SQL bez ucieczki.

- Ograniczone SELECT z ORDER/WHERE na indeksowanych kolumnach; duże aktualizacje w Partie zamiast w jednej transakcji trwającej wiele sekund.

- pre_get_posts oszczędnie i kontekstowo, tak aby nie każde zapytanie otrzymywało dodatkowe filtry globalne.

- REST/AJAX Punkty końcowe z buforowaniem, timeoutami i backoffem; bez sekundowych interwałów odpytywania.

- Procedury dezinstalacji które konsekwentnie usuwają tabele, opcje i stany nieustalone.

Plan krok po kroku zapewniający szybki sukces

Najpierw mierzę status quo i zapisuję liczby dla zapytań, TTFB i kompletności Czas załadunku. Następnie dezaktywuję wtyczki funkcyjne, usuwam osierocone tabele i ograniczam opcje automatycznego ładowania. W trzecim kroku optymalizuję największe powolne zapytania za pomocą indeksów i wsadów. Następnie aktywuję pamięć podręczną stron i obiektów oraz ustawiam rozsądne czasy TTL, aby pominięcia pamięci podręcznej były rzadkie. Na koniec testuję rzeczywiste scenariusze, monitoruję dzienniki błędów i dostosowuję szczegóły, aż kluczowe dane będą stabilne na zielono. Zasięg kłamstwo.

Podsumowanie

Zapytania wtyczek WP stają się hamulcem, gdy pojawiają się pętle, brakujące indeksy i wtyczki Dopplera Zapytania wzdęcia. Rozwiązuję to za pomocą pomiarów, ukierunkowanego audytu wtyczek, konserwacji bazy danych, dostrajania zapytań i buforowania. W ten sposób zmniejszam liczbę żądań, skracam czas odpowiedzi i utrzymuję Core Web Vitals w zielonej strefie. Kluczem jest jasna odpowiedzialność za wtyczkę i regularne audyty zamiast gorączkowych indywidualnych działań. Jeśli będziesz postępować zgodnie z tą mapą drogową, zauważysz, że Prędkość z dowolnej instalacji WordPress.