Viele Websites kollabieren unter Last, weil WP Plugin Queries bei jedem Seitenaufruf dutzende wiederholte Datenbankbefehle ausführen und dadurch die Datenbank blockieren. Ich zeige, wie diese WordPress-Plugin-Abfragen entstehen, warum einzelne Millisekunden pro Query sich zu Sekunden addieren und wie ich sie messbar senke.

Zentrale Punkte

- Ursache: Wiederholte Meta-Queries, N+1-Muster und fehlende Indizes

- Erkennung: Messung mit Query-Tools und schrittweises Deaktivieren

- Auswirkung: Schlechte Core Web Vitals, höhere Absprungrate

- Maßnahmen: Audit, Datenbankpflege, Caching, Query-Tuning

- Langfristig: Schlanke Plugins, saubere Transients, gutes Hosting

Warum Plugin-Abfragen die Datenbank überlasten

Jedes Plugin liest oder schreibt Daten, doch mehrere Plugins erzeugen zusammen schnell hunderte Queries pro Seite. Viele Tools feuern identische Abfragen für jede Post-ID ab, statt Ergebnisse zu bündeln und zu cachen. Ich sehe häufig Meta-Looks ohne passende Indizes, die pro Aufruf 0,05 Sekunden oder länger brauchen. Bei 50 Abfragen addiert sich das zu spürbarer Wartezeit, vor allem bei gleichzeitigen Besuchern. Kommen externe API-Calls von Social- oder Related-Features dazu, kippt die Performance in die Knie und die Ladezeit steigt deutlich.

Ursachen im Detail: Loops, Meta und N+1

Viele Plugins nutzen Loops, die für jeden Beitrag einzeln Metadaten laden, ein typisches N+1-Muster. Statt eine einzige SQL-Abfrage zu nutzen, entstehen dutzende kleine Hits mit steigender Laufzeit. Meta-Queries ohne Index auf meta_key oder meta_value kosten zusätzlich Zeit. Dazu kommen Options-Looks in autoloaded Optionen, die das wp_options-Laden aufblähen. Ich ersetze solche Muster gezielt durch gebündelte Abfragen und nutze wo möglich ein Object-Cache.

Taxonomie- und Term-Queries richtig handhaben

Neben Post-Meta sind Taxonomie-Abfragen ein zweiter, oft übersehener Lasttreiber. Auf Archiven und in Widgets frage ich häufig Begriffe, Zählungen oder verknüpfte Beiträge ab. Wenn Plugins hier pro Begriff einzelne get_terms-Aufrufe ausführen oder Posts je Term separat laden, entsteht erneut N+1. Ich fasse deshalb Term-IDs über IN()-Listen zusammen, lade zugehörige Beziehungen in einem Rutsch und deaktiviere unnötiges Preloading.

- Ich setze bei wp_term_relationships und wp_term_taxonomy auf passende Indizes (term_taxonomy_id, term_id), damit JOINs nicht in Full Scans laufen.

- Bei get_terms reduziere ich Felder auf das Nötigste (z. B. nur IDs), wenn ich Namen oder Slugs später nicht brauche.

- Ich meide LIKE-Suchen über Slugs und vermeide ORDER BY RAND(), das Listen komplett sortiert und Tabellen temporär groß macht.

- Bei hierarchischen Taxonomien cache ich berechnete Bäume aggressiv, damit tiefe Strukturen nicht bei jedem Seitenaufruf rekursiv erzeugt werden.

Konflikte, Redundanz und verwaiste Tabellen

Installiere ich Funktions-Doppler, etwa mehrere Analytics- oder SEO-Module, dann vervielfachen sich die Abfragen unnötig. Auch Widgets, die auf jeder Seite rendern, fragen Daten dauernd neu ab. Deaktivierte Plugins lassen oft Tabellen zurück, die Backups, Exporte und Wartung ausbremsen. Ich prüfe regelmäßig, welche Tabellen Waisen sind, und räume sie konsequent auf. So reduziere ich unnötige Last und gewinne spürbar Speed.

Wachstumseffekte: Revisions, Transients und Spam

Mit der Zeit bläht sich jede Installation auf: Post-Revisions, auslaufende Transients und Spam-Kommentare sammeln sich wie Ballast an. Viele Plugins legen zusätzlich eigene Tabellen an und reinigen sie nie automatisch. Ich plane daher feste Wartungsfenster und lösche historische Revisionen, alte Transients und Müll in Kommentaren. Einen tieferen Einblick in diese temporären Einträge gebe ich hier: Transients erklärt. Diese Aufräumrunden halten die Datenbank schlank und senken die durchschnittliche Queryzeit.

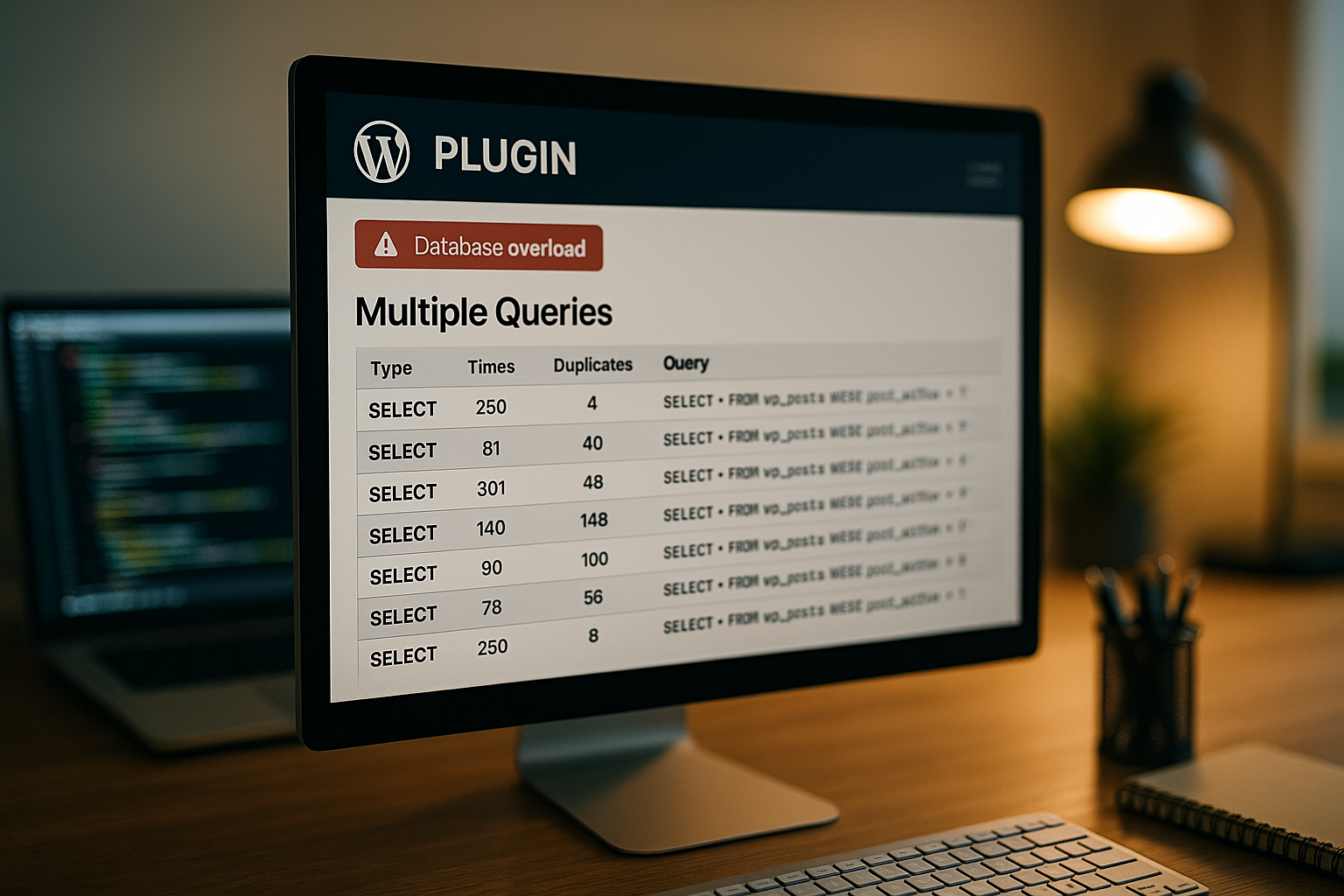

Messung: So finde ich wp slow plugins

Ich starte stets mit Messung, bevor ich etwas ändere, und nutze dafür Query-Analyse direkt im Backend. Das zeigt mir pro Seite, welche Abfragen wie lange laufen und welches Plugin sie auslöst. Für die Detailanalyse setze ich auf den folgenden Leitfaden: Query Monitor. Danach deaktiviere ich testweise Plugin-Gruppen, lade die Seite neu und vergleiche die Zahlen. So sehe ich schnell, welche wp slow plugins Echtzeit kosten und wo ich zuerst ansetze, um die Latenz zu drücken.

Suchfunktionen, Pagination und Archive

Suche und Archivseiten gehören zu den Query-intensivsten Bereichen. Ich optimiere WP_Query gezielt über Parameter: Wenn ich nur IDs brauche, lade ich keine vollständigen Post-Objekte. Auf Such- und Listingseiten deaktiviere ich das Ermitteln der Gesamtanzahl, wenn ich ohnehin keine Paginierung mit Seitennummern anzeigen muss.

- no_found_rows: true setzen, wenn die Gesamtzahl der Treffer nicht benötigt wird – das spart teure COUNTs.

- fields: ‚ids‘ verwenden, wenn ein nachgelagerter Batch die Details lädt oder ich nur Verweise brauche.

- update_post_meta_cache und update_post_term_cache: für Listen, die nur Titel/Permalinks zeigen, auf false.

- LIKE-Suche entschärfen: Ich begrenze Suchbegriffe, reinige Wildcards und erwäge FULLTEXT-Indizes, wenn es zum Content passt.

- Unbegrenzte Paginierung meide ich: Ich setze sinnvolle Seitenlängen und harte Obergrenzen für Offsets, um nicht in tiefe Scans zu laufen.

Auswirkungen auf Performance und SEO

Lange Antwortzeiten verschlechtern die First Byte Time und ziehen die Core Web Vitals nach unten. Ab drei Sekunden Verzögerung steigt die Absprungrate deutlich und Signale an Suchmaschinen kippen. Ich richte jede Optimierung auf ein Ziel unter 2,5 Sekunden aus und messe vor und nach jeder Änderung. Caching puffert viel ab, doch ineffiziente Queries bleiben ein Risiko bei Cache-Misses. Deshalb löse ich die Ursache und nicht nur die Symptome.

Plugin-Auswahl: Performance-Antipatterns vermeiden

Ich wähle Plugins nach Funktionsbedarf und Laufzeitkosten, nicht nach Funktionsfülle oder Bequemlichkeit. Große Suite-Plugins ersetze ich oft durch ein leichtes Modul mit klarer Aufgabe. Typische Antipatterns, die Zeit kosten, fasse ich in diesem Beitrag zusammen: Performance-Antipatterns. Vor jeder Installation prüfe ich Changelog, Datenbanktabellen und ob das Plugin serverseitiges Caching respektiert. So vermeide ich Zusatzlast, reduziere Abhängigkeiten und halte die Queries im Zaum.

WooCommerce, Memberships und komplexe Daten

Shops, Membership- und LMS-Systeme verstärken alle Muster: mehr Tabellen, mehr Joins, mehr Schreibvorgänge. In WooCommerce prüfe ich, ob Bestell- und Produktdaten effizient abgefragt werden, ob Carts und Fragmente nicht auf jeder Seite dynamisch erstellt werden müssen und ob kombinierte Indizes auf häufig genutzten Filtern (Status, Datum, Kunde) vorhanden sind. Große Postmeta-Tabellen bremsen besonders: Ich setze soweit möglich auf schlanke Schemata und vermeide, dass jedes Plugin eigene, redundante Produkt-Metadaten schreibt.

- Ich minimiere Live-Abfragen im Checkout und cache Katalogelemente (Preisregeln, Verfügbarkeiten) mit klarer Invalidierung bei Änderungen.

- Ich sorge dafür, dass Dashboard-Widgets in Admin-Bereichen nicht bei jedem Aufruf vollständige Statistiken neu berechnen.

- Ich reduziere AJAX-Intervalle (z. B. Cart-Refresh) und setze harte Timeouts und Backoff-Strategien, damit Fehlerspitzen die DB nicht fluten.

WP-Cron, Hintergrundjobs und Rate Limiting

Hintergrundaufgaben sind oft unauffällig – bis sie in der Hauptnutzungszeit alle gleichzeitig laufen. Ich verteile Cron-Jobs über den Tag, limitiere Batchgrößen und sorge für Locking, damit Jobs nicht doppelt starten. Exporte, Synchronisationen und Berichtserstellungen laufen bei mir zeitversetzt und bevorzugt außerhalb von Traffic-Peaks. Zusätzlich setze ich Rate Limiting für externe Requests, damit API-Fehler keine Kaskaden auslösen.

Query-Optimierung: Indizes und Batching

Ich analysiere langsame Statements, prüfe die EXPLAIN-Ausgabe und setze passende Indizes. Fehlt ein Index auf meta_key oder kombinierten Spalten, fällt die Laufzeit je nach Größe stark aus. Zusätzlich fasse ich wiederholte Einzelabfragen zu einer gebündelten Abfrage zusammen. Wo ein Plugin N+1 erzeugt, ersetze ich die Schleife durch ein Preload aller benötigten IDs. Mit sauberem Batching und guten Indizes sinkt die Query-Anzahl und die mittlere Dauer spürbar.

Messung vertiefen: Slow Query Log, EXPLAIN und APM

Neben der Oberflächenanalyse gehe ich tiefer: Ich aktiviere das Slow-Query-Log mit einer sinnvollen Schwelle und schaue mir nicht nur die reinen Zeiten, sondern auch die Häufigkeit an. Ein schneller Query, der tausendmal pro Seite läuft, ist ein größerer Hebel als ein einzelner Ausreißer. Die EXPLAIN-Ausgabe nutze ich im JSON-Format, um Schlüsselverwendung, Join-Strategien und temporäre Tabellen klar zu erkennen. Ergänzend beobachte ich über APM-Traces, ob PHP-Laufzeiten oder Netzwerkwartezeiten parallel mitlaufen und die Gesamtdauer erklären.

Object Caching, Redis und Hosting

Ein Object-Cache hält Ergebnisse wiederkehrender Abfragen im Arbeitsspeicher und senkt die Last sofort. In vielen Setups genügen wenige Minuten TTL, um Peaks zu glätten und Seiten dynamisch schnell auszuliefern. Ich prüfe dabei, ob Plugins transiente Daten korrekt setzen und invalidieren. Zusätzlich aktiviere ich Page-Cache, minimiere Autoload-Optionen und nutze PHP 8+ für schnellere Ausführung. Diese Kombination reduziert die Query-Rate signifikant und erhöht die Reaktionszeit unter Last.

Datenbank-Engine und Konfiguration

Neben dem Code ist die DB-Konfiguration ein Performance-Faktor. Ich wähle InnoDB mit ausreichend großem Buffer Pool, damit Hot-Daten im RAM bleiben. Temporary- und Sort-Puffer dimensioniere ich so, dass häufige Sorts und GROUP BYs nicht auf die Platte ausweichen müssen. Ich nutze utf8mb4 für volle Unicode-Kompatibilität und konsistente Kollationen, damit Vergleiche vorhersehbar und indexfreundlich bleiben. Autocommit- und Flush-Strategien wähle ich je nach Persistenzanforderung, ohne die Datensicherheit zu kompromittieren.

- Ich überwache tmp tables on disk und passe Schwellenwerte an, damit große Sorts nicht dauernd in Files auslagern.

- Ich halte die Anzahl gleichzeitiger Verbindungen im Blick und setze auf Verbindungspooling durch den PHP-Handler statt extrem hoher DB-Limits.

- Ich plane regelmäßige ANALYZE/OPTIMIZE-Fenster, wenn Statistiken veralten oder Tabellen stark fragmentieren – mit Bedacht und Monitoring.

Object Cache: Keys, TTLs und Invalidation

Ein Cache ist nur so gut wie seine Invalidierung. Ich definiere Cache-Keys konsistent (Site-ID, Sprache, Benutzerkontext) und verhindere Cache-Stampedes durch kurze, gestaffelte TTLs und Locking. Nach Content-Updates lösche ich gezielt betroffene Keys, statt global alles zu verwerfen. Ergebnis: weniger kalte Starts, stabilere Antwortzeiten und deutlich geringere Query-Last.

- Ich unterscheide zwischen persistierenden und nicht-persistierenden Gruppen und komprimiere große Payloads bei Bedarf.

- Ich prime kritische Caches nach Deployments, damit der erste Nutzer nicht den vollen Aufbau-Zoll bezahlt.

- Ich achte darauf, dass Transients nicht als Dauerlösung zweckentfremdet werden, wenn ein echter Object-Cache verfügbar ist.

Tabelle: Kostenfaktoren und Fixes

Die folgende Übersicht zeigt typische Kostentreiber, ihre Wirkung und was ich konkret dagegen unternehme, um die Last zu senken.

| Problemtyp | Typische Query / Muster | Folge | Schneller Fix | Dauer-Effekt |

|---|---|---|---|---|

| Meta N+1 | get_post_meta je Post | Viele kleine Hits | Batch-Load per IN() | Weniger Queries |

| Kein Index | meta_key LIKE ‚%‘ | Full Table Scan | Index auf meta_key | Kürzere Laufzeit |

| Autoload-Bloat | Aufgeblähte wp_options | Höhere TTFB | Autoload reduzieren | Schnelleres Laden |

| Externe Calls | APIs pro Seitenaufruf | Blockierende Wartezeit | Serverseitig cachen | Konstante Antwort |

| Transients-Leichen | Abgelaufen, aber vorhanden | Mehr DB-Volumen | Regelmäßig räumen | Schlankere Daten |

Skalierung: Read-Replicas und Edge-Caching

Wenn Optimierung nicht mehr reicht, skaliere ich: Read-Replicas entkoppeln Lese- von Schreiblast, vorausgesetzt, ich verstehe Replikationslatenzen und route schreibkritische Pfade (Checkout, Kommentare) weiterhin auf das Master-System. Edge- und Page-Caches reduzieren dynamische Abfragen für anonyme Nutzer drastisch. Wichtig ist ein klares Invalidierungskonzept, damit Content-Änderungen zügig sichtbar werden, ohne den Cache komplett zu leeren.

- Ich identifiziere wirklich statische Seitenteile (Navigation, Footer, Listen) und cache sie länger, dynamische Bereiche kürzer.

- Ich trenne Benutzerkontext klar: Angemeldete Nutzer umgehen Page-Cache, profitieren aber vom Object-Cache und schlanken Queries.

- Ich beobachte Replikationsverzug und halte sicherheitsrelevante Aktionen strikt konsistent.

Robuste Code-Patterns in Plugins

Guter Code vermeidet Lastspitzen automatisch. Ich schreibe Queries stets vorbereitet und begrenze Ergebnismengen hart. Für wiederkehrende Aufgaben nutze ich dedizierte Services statt wild verstreuter Hooks, die mehrfach feuern. Bei Deinstallation räume ich Daten auf, damit Waisen nicht zurückbleiben.

- Prepared Statements mit sauberer Typisierung; keine dynamischen SQL-Fragmente ohne Escaping.

- Begrenzte SELECTs mit ORDER/WHERE auf indizierten Spalten; große Updates in Batches statt in einer Transaktion über viele Sekunden.

- pre_get_posts sparsam und kontextsensitiv einsetzen, damit nicht jeder Query global zusätzliche Filter bekommt.

- REST/AJAX Endpunkte mit Caching, Timeouts und Backoff; keine Sekunden-Intervalle für Polling.

- Uninstall-Routinen schreiben, die Tabellen, Optionen und Transients konsequent entfernen.

Schritt-für-Schritt-Plan für schnelle Erfolge

Ich messse zuerst den Status quo und sichere Zahlen für Abfragen, TTFB und vollständige Ladezeit. Danach deaktiviere ich funktionsähnliche Plugins, lösche Waisen-Tabellen und reduziere Autoload-Optionen. Im dritten Schritt optimiere ich die größten Slow-Queries durch Indizes und Batching. Anschließend aktiviere ich Page- und Object-Cache und setze sinnvolle TTLs, damit Cache-Misses selten bleiben. Zum Schluss teste ich reale Szenarien, beobachte Fehler-Logs und feile an Details, bis die Kennzahlen stabil im grünen Bereich liegen.

Zusammenfassung

WP Plugin Queries werden zur Bremse, wenn Loops, fehlende Indizes und Doppler-Plugins die Abfragen aufblähen. Ich löse das mit Messung, gezieltem Plugin-Audit, Datenbankpflege, Query-Tuning und Caching. So reduziere ich Anfragen, senke Antwortzeiten und halte Core Web Vitals im grünen Bereich. Der Schlüssel liegt in klaren Verantwortlichkeiten je Plugin und regelmäßigen Audits, statt hektischen Einzelmaßnahmen. Wer diesen Fahrplan befolgt, holt spürbar Tempo aus jeder WordPress-Installation heraus.